AIナレッジベース構築プレイブック――音声データから社内Wikiを作る

音声データをAIで文字起こし・構造化し、検索可能なナレッジベースを構築する4フェーズの実践手順を解説。プロンプトテンプレート・KPI設計・30日チェックリスト付き。

チェックリスト

- ナレッジベースの目的・対象者・蓄積範囲を定義した

- 既存の音声データを棚卸しし、優先順位を付けた

- 文字起こしツールを選定し、テスト変換を実施した

- 話者分離とタイムスタンプの設定を完了した

- 構造化用のプロンプトテンプレートを作成した

- チャンクサイズとメタデータの設計を完了した

- パイロット10件の音声をナレッジドキュメントに変換した

- 検索インターフェースを構築し、テスト検索を実施した

- KPIの計測方法とベースラインを設定した

- 月次メンテナンスのルーティンをカレンダーに登録した

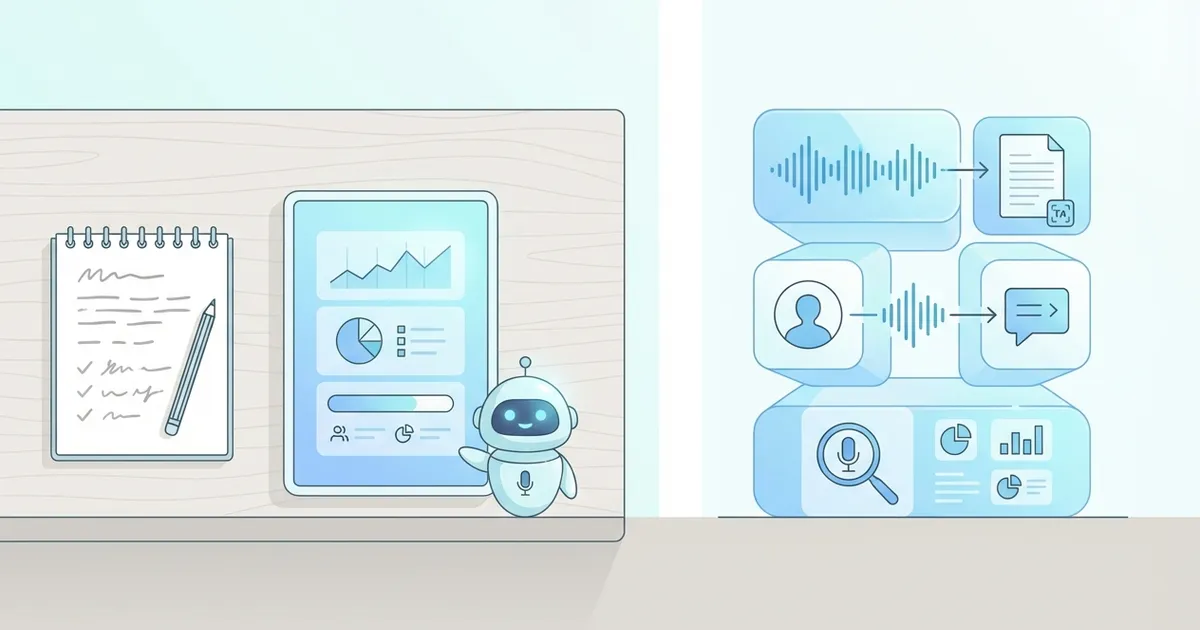

この記事のゴール――音声データを「検索できるナレッジ資産」に変える

「会議の録音が100本以上あるのに、誰も聞き返していない」。「研修の音声をアーカイブしたけど、必要な情報を探すのに全編再生するしかない」。

こうした状況は、音声データを蓄積している組織の大半が抱える共通課題です。録音はあるのに活用されない。その理由はシンプルで、 音声は「検索できない」から です。

本記事は、眠っている音声データを AI の力で文字起こし・構造化し、検索可能な AI ナレッジベース として構築するための実践プレイブックです。4つのフェーズに分けて、設計から運用まで具体的な手順を解説します。

4フェーズの全体像

| フェーズ | やること | 成果物 | 目安期間 |

|---|---|---|---|

| 1. 設計 | スコープとゴールを定義する | スコープ定義書 | 1〜3日 |

| 2. 変換 | 音声をテキストに高精度で変換する | 話者分離済みトランスクリプト | 3〜5日 |

| 3. 構造化 | 生成AIでナレッジドキュメントに整理する | タグ付き構造化ドキュメント | 5〜7日 |

| 4. 蓄積・運用 | 検索可能な状態で公開し、定着させる | 運用中のナレッジベース | 7〜14日 |

すでに録音済みの音声データを持っている方は、フェーズ1の設計さえ終われば実質的な構築作業に入れます。つまり、 AI ナレッジベース構築の第一歩はすでに完了している のです。

前提条件と推奨ツール

このプレイブックを実行するにあたり、以下を前提とします。

- 音声データ: 録音済みの会議、研修、コーチングセッション等が10件以上ある

- 文字起こしツール: OpenAI Whisper、Google Speech-to-Text、またはこれらを統合したサービス

- 生成AI: GPT-4o、Claude、Gemini 等のLLM(プロンプトによる構造化に使用)

- ナレッジベース基盤: Notion、Confluence、社内Wiki、または独自構築のRAGシステム

特別な開発スキルは不要です。SaaSツールの組み合わせだけでも、本記事の手順を十分に実行できます。

なぜ「音声→ナレッジベース」なのか――テキスト入力が続かない3つの理由

「ナレッジベースを作るなら、最初からテキストで書けばいいのでは?」。そう考えるのは自然です。しかし、テキスト入力を前提としたナレッジベースの多くが「作ったけど使われない」状態に陥る理由を理解しておく必要があります。

記録コストの壁――書く時間がない問題

30分の会議内容を正確にテキスト化するには、少なくとも15〜30分の追加作業が必要です。McKinsey の調査によれば、知識労働者は業務時間の約19%を情報の検索・収集に費やしているとされています。ただでさえ時間が足りない中で「毎回書く」文化を定着させることは、構造的に困難です。

音声データなら、録音ボタンを押すだけで記録が完了します。記録コストが事実上ゼロになるため、 「忙しくて書けない」という最大の障壁を根本から取り除ける のです。

パラ言語情報の価値――テキストでは伝わらないもの

音声には、テキストでは表現できない情報が含まれています。声のトーン、話す速度、間の取り方、言い淀みからの言い換え。こうした パラ言語情報 は、発話者の確信度や感情状態を伝える重要なシグナルです。

Albert Mehrabian の研究(実験条件下の知見であり、日常会話にそのまま適用できるわけではない点に注意)では、感情的メッセージの伝達において声のトーンが38%の影響力を持つとされています。「この方法はうまくいく」という同じ言葉でも、確信に満ちた声で語られるのと、ためらいがちに語られるのとでは、受け取る情報量がまったく異なります。

AI文字起こしでテキスト化した後も、元の音声へのリンクを保持しておくことで、テキスト検索で見つけた箇所の音声を直接確認できます。この テキスト×音声のハイブリッド参照 が、音声ナレッジベースの最大の強みです。

既存資産の活用――「今ある音声」がそのまま原材料になる

多くの組織は、すでに大量の音声データを保有しています。Zoomの録画、研修のアーカイブ、コーチングセッションの録音、ポッドキャスト形式の社内配信。こうした音声資産は、テキスト入力型のナレッジベースでは活用のしようがありませんでした。

しかし、AI文字起こしの精度が飛躍的に向上した今、これらの 音声データ はそのまま AI ナレッジベース構築 の原材料になります。新しくコンテンツを「作る」のではなく、既にあるものを「変換する」。これが、音声からナレッジベースを構築する最も合理的な理由です。

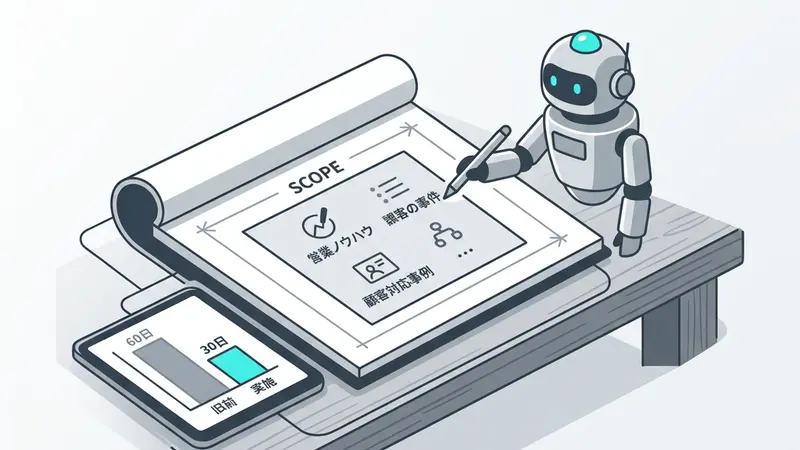

フェーズ1 設計――スコープとゴールを決める

いきなり音声の文字起こしを始めるのは、設計図なしに家を建てるようなものです。最初に「何のために、誰のために、どの範囲で」ナレッジベースを構築するかを明確にしましょう。

スコープ設計テンプレート

以下のテンプレートを埋めることで、プロジェクトの輪郭が明確になります。

| 項目 | 記入例 | あなたの定義 |

|---|---|---|

| 目的 | 新人の立ち上がり期間を50%短縮する | |

| 対象者 | 入社3か月以内の新入社員 | |

| 蓄積範囲 | 営業部門の商談ノウハウ・顧客対応事例 | |

| 除外範囲 | 個人の人事評価に関する情報 | |

| 成功指標 | 新人の初受注までの平均日数が60日→30日 |

スコープが曖昧なまま始めると、「何でも入れる」ナレッジベースになり、結局「何も見つからない」状態に陥ります。 最初は狭く、成果が出たら広げる のが鉄則です。

音声データの棚卸しと優先順位づけ

既存の音声データを一覧化し、ナレッジベースに取り込む優先順位をつけます。

優先度の判定基準:

| 優先度 | 基準 | 例 |

|---|---|---|

| 高 | 繰り返し参照される可能性が高い | 業務手順の説明、ベストプラクティス共有会 |

| 高 | 属人化リスクが高い | ベテラン社員のノウハウ共有、退職予定者のナレッジ |

| 中 | 定期的に更新される情報 | 月次の振り返り会議、研修セッション |

| 低 | 一時的・文脈依存が強い | 日常の進捗報告、雑談ベースのミーティング |

パイロットとして 優先度「高」の音声データを10〜20件選定 し、フェーズ2に進みます。全データを一度に変換しようとせず、小さく始めて成果を確認しながら拡大する方が、失敗リスクを大幅に下げられます。

フェーズ2 変換――音声をテキストに高精度で変換する

スコープが決まったら、音声データをテキストに変換します。AI文字起こしの精度は2025年以降大きく向上しており、適切な設定を行えば実用レベルのトランスクリプトを得られます。

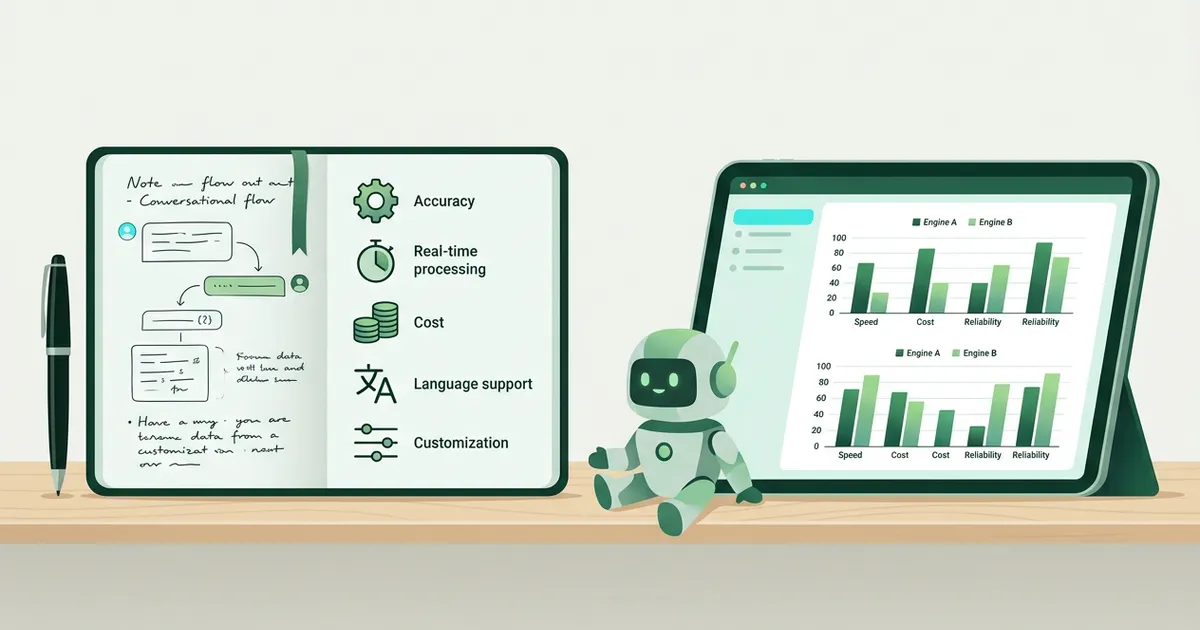

文字起こしツールの選定基準

ツール選定では、以下の4つの基準を重視します。

| 基準 | 重要な理由 | チェックポイント |

|---|---|---|

| 日本語精度 | 専門用語の認識率が成果物の品質を左右する | WER(単語誤り率)が10%以下 |

| 話者分離 | 「誰が言ったか」がわからないと文脈が崩れる | 話者ラベルの自動付与に対応 |

| タイムスタンプ | 元音声への参照リンクに必須 | セグメント単位でのタイムスタンプ出力 |

| バッチ処理 | 大量の既存音声を効率的に処理する | API経由での一括処理に対応 |

AI文字起こしの精度や各ツールの特性についてさらに詳しく知りたい方は、AI文字起こし精度ベンチマークの記事が参考になります。

話者分離とタイムスタンプの設定

AI ナレッジベース の品質を左右する最も重要な設定が、話者分離(ダイアライゼーション)とタイムスタンプです。

話者分離の設定ポイント:

- 参加者数が事前にわかっている場合は、話者数を指定する(精度向上に直結)

- 話者ラベルは後から「営業担当」「顧客」等の役割名に置換する

- 1対1のセッション録音は話者分離の精度が最も高い

タイムスタンプの活用法:

[00:05:23] 営業部長: このクライアントには、最初に課題のヒアリングから入る。

いきなり提案書を見せると、押し売りに感じられるから。

[00:05:45] 新人: 課題のヒアリングは、具体的にどんな質問をされていますか?

[00:05:52] 営業部長: まず「現状で一番困っていることは何ですか」から始める。このように、タイムスタンプ付きのトランスクリプトがあれば、テキスト検索で該当箇所を見つけ、必要に応じて元の音声をピンポイントで再生できます。

品質チェックの仕組み

AI文字起こしは完璧ではありません。特に専門用語、固有名詞、同音異義語はエラーが発生しやすい箇所です。

効率的な品質チェックフロー:

- 自動チェック: 社内用語辞書と照合し、未登録語や明らかな誤変換をフラグ付け

- サンプルチェック: パイロット10件のうち3件をランダムに選び、音声と突合(全件チェックは非効率)

- フィードバックループ: 発見した誤変換パターンを辞書に追加し、次回以降の精度を改善

完璧を目指すと永遠に終わりません。 「検索でヒットし、文脈が理解できるレベル」を品質基準 とし、細かな表記ゆれは許容するのが現実的です。

フェーズ3 構造化――生成AIでナレッジドキュメントに整理する

文字起こしが完了した段階では、まだ「長いテキストの塊」にすぎません。これを検索可能で再利用しやすいナレッジドキュメントに変換するのが、フェーズ3の役割です。ここで 生成AIの構造化能力 が真価を発揮します。

プロンプトテンプレート3選

以下の3つのプロンプトテンプレートを使い分けることで、音声データを目的に応じたナレッジドキュメントに変換できます。

テンプレート1: 要約+キーポイント抽出

あなたは社内ナレッジの編集者です。以下のトランスクリプトを読み、次の形式で構造化してください。

概要(3文以内)

{全体の要約}

キーポイント(箇条書き、5項目以内)

{重要な知見や意思決定事項}

アクションアイテム

{具体的な次のステップ}

関連トピック(タグ候補)

{このナレッジに関連するキーワード、3〜5個}

トランスクリプト: {ここにトランスクリプトを貼り付け}

テンプレート2: FAQ変換

以下のトランスクリプトから、Q&A形式のFAQドキュメントを作成してください。

- 質問は「現場で実際に聞かれそうな形」で書く

- 回答はトランスクリプトの内容に基づき、200文字以内で簡潔にまとめる

- 情報が不足している場合は「詳細は{元音声リンク}を参照」と補足する

- 5〜10個のQ&Aを抽出する

トランスクリプト: {ここにトランスクリプトを貼り付け}

テンプレート3: 手順書変換

以下のトランスクリプトから、ステップバイステップの手順書を作成してください。

- 各ステップは「動詞で始まる」形式にする

- ステップごとに「注意点」があれば補足する

- 判断が必要なポイントには「判断基準」を添える

- 手順の全体像がわかるフロー図(テキスト表現)を冒頭に置く

トランスクリプト: {ここにトランスクリプトを貼り付け}

チャンクサイズとメタデータの設計

構造化したドキュメントをナレッジベースに格納する際、 チャンクサイズ (1つの検索単位の大きさ)の設計が検索精度を大きく左右します。

| チャンクサイズ | 適したコンテンツ | メリット | デメリット |

|---|---|---|---|

| 200〜400文字 | FAQ、用語定義 | ピンポイントで正確な検索結果 | 文脈が失われやすい |

| 500〜800文字 | 手順書、ノウハウ共有 | 文脈を保ちつつ検索精度も確保 | 汎用的だがやや大きい |

| 1000〜1500文字 | 事例報告、意思決定の背景 | 豊富な文脈を保持 | 検索結果が冗長になりがち |

推奨は 500〜800文字 です。音声トランスクリプトは口語的で文が長くなりがちなので、やや大きめのチャンクで文脈を保つほうが検索結果の品質が上がります。

各チャンクに付与すべきメタデータ:

- ソース情報: 元の音声ファイル名、録音日時、話者

- トピックタグ: 3〜5個のキーワード(生成AIで自動付与)

- コンテンツタイプ: ノウハウ / 事例 / 手順 / 意思決定 / FAQ

- 元音声リンク: タイムスタンプ付きの音声参照URL

- 鮮度フラグ: 作成日と最終確認日(陳腐化管理用)

AI構造化の精度を高める3つのコツ

- ドメイン用語辞書を添付する: プロンプトに「以下の用語は正確に使用してください」と辞書を添えると、専門用語の取り扱いが改善される

- 1回のプロンプトに1つの音声: 複数のトランスクリプトを一度に処理すると、情報が混在するリスクがある。1音声1回の処理を基本とする

- 出力を必ず人間がレビューする: AIの要約は論点を取りこぼすことがある。特に「言外の意味」や「文脈依存の判断基準」は、AIの出力を読んだ人間が補足を加える工程を必ず挟む

コーチングセッションの録音を AI でナレッジ化する具体的な手順については、コーチングセッションをAIでナレッジ化する5つのステップでさらに詳しく解説しています。

フェーズ4 蓄積・運用――使われるナレッジベースにする

構造化されたドキュメントが揃っても、「使われない」ナレッジベースでは意味がありません。フェーズ4では、検索設計と定着施策の2つの観点から、 「使いたくなる」AI ナレッジベース を構築します。

検索設計――セマンティック検索とキーワード検索のハイブリッド

ナレッジベースの価値は「探したい情報がすぐ見つかること」に集約されます。検索の仕組みは以下のハイブリッド方式が効果的です。

ユーザーの質問

↓

┌───────────────────┐

│ キーワード検索 │ ← 固有名詞・型番・日付に強い

│ (完全一致・部分一致) │

└────────┬──────────┘

│

┌────────▼──────────┐

│ セマンティック検索 │ ← 意味的に近い情報を発見

│ (ベクトル検索/RAG) │

└────────┬──────────┘

│

┌────────▼──────────┐

│ リランキング │ ← 関連度順に並べ替え

│ (クロスエンコーダー) │

└────────┬──────────┘

│

検索結果 Top5キーワード検索だけでは「別の言い回し」に対応できず、セマンティック検索だけでは固有名詞のピンポイント検索が弱い。両方を組み合わせることで、 「探し方を知らなくても見つかる」 ナレッジベースが実現します。

ナレッジベースにおけるAI検索の設計方法をさらに深く知りたい方は、社内ナレッジベースの構築――音声アーカイブ×AI検索で情報を見つけやすくが参考になります。

定着施策――行動科学で「使う習慣」をつくる

ナレッジベースが「使われない」最大の原因は、既存の業務フローの中にナレッジベースを参照するステップが組み込まれていないことです。行動科学の知見を応用して、自然に使われる仕組みを設計します。

デフォルト効果を活用する:

人は「初期設定のまま」行動する傾向があります。新しいプロジェクト開始時のテンプレートに「関連ナレッジの確認」をデフォルトのチェック項目として組み込む。削除はできるが、最初から入っていることで確認率が大幅に向上します。

社会的証明で利用を促進する:

「先週最も参照されたナレッジ Top5」を週次で共有する。他の人が使っている事実を見せることで、「自分も使ってみよう」という動機が生まれます。利用ランキングやアクセス数の可視化は、バンドワゴン効果を自然に引き起こします。

小さな成功体験を設計する:

ナレッジベース導入直後に、新人が「30秒で必要な情報を見つけられた」という体験をさせる。この最初の成功体験が、以後の継続利用を決定的に左右します。パイロットユーザーには意図的に「見つけやすいナレッジ」を検索させる体験設計が有効です。

月次メンテナンスのルーティン

AI ナレッジベース は構築して終わりではありません。情報の鮮度を維持し、利用価値を高め続けるために、月次の定期メンテナンスを実施します。

| 作業 | 頻度 | 所要時間 | 担当 |

|---|---|---|---|

| 新規音声の変換・追加 | 週次 | 30分〜1時間 | ナレッジ担当 |

| 陳腐化コンテンツの確認・更新 | 月次 | 1〜2時間 | 各部門のSME |

| 検索ログの分析(ゼロヒット検索の特定) | 月次 | 30分 | ナレッジ担当 |

| タグ・カテゴリの見直し | 四半期 | 1〜2時間 | ナレッジ担当 |

| KPIレビューと改善施策の検討 | 月次 | 1時間 | プロジェクトオーナー |

特に重要なのが ゼロヒット検索の分析 です。ユーザーが検索したのに結果がゼロだった検索クエリは、ナレッジベースに欠けている情報を直接示しています。このギャップを埋めるために新たな音声コンテンツを意図的に収録する。この 需要起点のコンテンツ追加 が、ナレッジベースの価値を継続的に高める最も効率的な方法です。

成果の測り方――KPIとROIシミュレーション

「ナレッジベースが役に立っている」という感覚だけでは、継続的な投資を正当化できません。具体的なKPIを設定し、定量的に成果を測定しましょう。

4つの主要KPI

| KPI | 計算式 | 目安 |

|---|---|---|

| 検索ヒット率 | ヒットありの検索数 / 全検索数 x 100 | 80%以上 |

| ナレッジ利用率 | 月間ユニーク利用者数 / 対象ユーザー総数 x 100 | 60%以上 |

| 記録投稿頻度 | 月間の新規ナレッジ追加件数 | 対象部門あたり月10件以上 |

| 情報探索時間削減率 | (導入前の平均探索時間 - 導入後の平均探索時間) / 導入前の平均探索時間 x 100 | 50%以上 |

導入初月は検索ヒット率が60%程度でも問題ありません。ゼロヒット検索のフィードバックループを回すことで、3か月後には80%を超えるケースが多いとされています。

ROIシミュレーション

AI ナレッジベース構築 の投資対効果を、保守的な前提で試算します。

前提条件:

- 対象: 30名の部門

- 導入前の情報探索時間: 1人あたり週3時間(McKinsey調査の19%を基に算出)

- 導入後の情報探索時間: 1人あたり週1.5時間(50%削減を想定)

- 人件費単価: 時給3,000円

月間の時間削減効果:

30名 x 1.5時間/週 x 4週 = 180時間/月月間のコスト削減効果:

180時間 x 3,000円 = 540,000円/月構築コスト(初期投資):

| 項目 | 概算 |

|---|---|

| 文字起こしAPI利用料(100時間分) | 30,000〜50,000円 |

| 生成AI API利用料(構造化処理) | 10,000〜20,000円 |

| ナレッジベース基盤(SaaS月額) | 10,000〜50,000円 |

| 人件費(設計・構築に40時間) | 120,000円 |

| 合計 | 170,000〜240,000円 |

保守的に見積もっても、 初月で投資回収が可能 です。実際には時間削減以外にも、新人の立ち上がり期間短縮、属人化リスクの低減、意思決定品質の向上など、定量化しにくい効果が加わります。

チェックリスト――30日で音声ナレッジベースを立ち上げる

以下のチェックリストに沿って進めれば、30日でパイロット版の AI ナレッジベース を立ち上げられます。

Week 1: 設計フェーズ(Day 1〜7)

- ナレッジベースの目的・対象者・蓄積範囲を定義した

- 既存の音声データを棚卸しし、優先順位を付けた

- パイロットとして取り込む音声を10〜20件選定した

- 成功指標(KPI)とベースラインの数値を設定した

Week 2: 変換フェーズ(Day 8〜14)

- 文字起こしツールを選定し、テスト変換を3件実施した

- 話者分離とタイムスタンプの設定を最適化した

- 品質チェックのサンプルレビューを実施した

- パイロット全件の文字起こしを完了した

Week 3: 構造化フェーズ(Day 15〜21)

- 構造化用のプロンプトテンプレートを用途別に作成した

- チャンクサイズとメタデータの設計を完了した

- パイロット10件の音声をナレッジドキュメントに変換した

- 人間レビューで構造化結果を確認・補足した

Week 4: 蓄積・運用フェーズ(Day 22〜30)

- ナレッジベース基盤にドキュメントを格納した

- 検索インターフェースを構築し、テスト検索を5件以上実施した

- パイロットユーザー3〜5名に利用テストを実施した

- 月次メンテナンスのルーティンをカレンダーに登録した

30日タイムライン

| 日 | マイルストーン |

|---|---|

| Day 1〜3 | スコープ定義完了 |

| Day 4〜7 | 音声データ棚卸し・選定完了 |

| Day 8〜10 | 文字起こしツール選定・テスト完了 |

| Day 11〜14 | パイロット全件の文字起こし完了 |

| Day 15〜17 | プロンプトテンプレート作成・テスト完了 |

| Day 18〜21 | 構造化ドキュメント作成完了 |

| Day 22〜25 | ナレッジベース構築・検索テスト完了 |

| Day 26〜28 | パイロットユーザーテスト実施 |

| Day 29〜30 | フィードバック反映・運用ルーティン設定 |

まとめ――音声データは「眠れる資産」、今日から掘り起こそう

本記事では、 AI ナレッジベース を 音声データ から構築する4フェーズのプレイブックを解説しました。

要点の振り返り:

- フェーズ1(設計): スコープを絞り、パイロットで小さく始める

- フェーズ2(変換): 話者分離とタイムスタンプで音声をテキスト化する

- フェーズ3(構造化): プロンプトテンプレートで目的別にドキュメント化する

- フェーズ4(運用): ハイブリッド検索と行動科学で「使われる」仕組みを作る

音声データは、テキストと違って「話すだけ」で記録が完了します。記録コストが限りなくゼロに近いこのメディアを、AIの力でナレッジ資産に変換する。それが、情報の埋没と属人化を同時に解決する最も実践的なアプローチです。

まずはチェックリストの最初の1項目、「ナレッジベースの目的・対象者・蓄積範囲を定義する」から始めてみてください。

音声コーチングや社内研修の録音をナレッジ資産として活用することに関心がある方は、BootCast のような音声プラットフォームを活用すると、録音から文字起こし・AI要約までをワンストップで実現できます。AIと教育の可能性についてさらに詳しく知りたい方はこちらもご覧ください。