Whisper vs Google Speech-to-Text――コーチング用途の文字起こし比較

Whisper と Google Speech-to-Text をコーチング用途で徹底比較。精度・リアルタイム性・コスト・日本語対応・カスタマイズ性の5軸で違いを整理し、セッション形式別の最適エンジンの選び方を解説します。

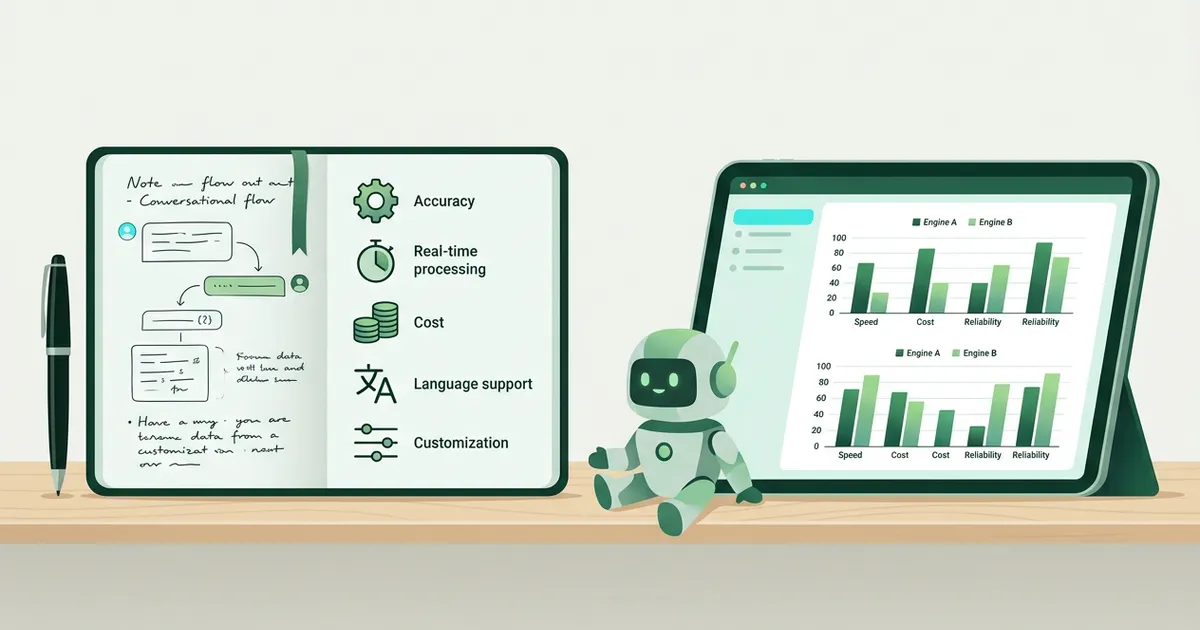

「Whisper と Google、どっちを使えばいい?」の前に押さえるべき5つの比較軸

コーチングセッションの文字起こしを自動化したい。そう考えてツールを調べ始めると、必ず候補に上がるのが OpenAI の Whisper と Google Speech-to-Text の2つです。

しかし、「精度が高いほうを選べばいい」という単純な話ではありません。コーチングの文字起こしには、一般的な議事録や字幕とは異なる固有の要件があるからです。

コーチング文字起こしに求められる要件とは

コーチングセッションの音声には、ビジネス会議にはない特徴があります。

- 感情のニュアンス: クライアントの声のトーン変化や沈黙を正確に記録する必要がある

- 自然な会話: フィラー(「えーと」「あの」)や言い直しが多く、整形された発話ではない

- 専門用語と日常語の混在: コーチング手法の専門用語と、クライアント固有の業界用語が混在する

- 長時間の連続録音: 1セッション30〜90分の連続音声を途切れなく処理する必要がある

- 守秘義務への配慮: クライアントの個人情報を含むため、データの取り扱いに注意が必要

これらの要件を満たすエンジンを選ぶために、以下の 5つの比較軸 で Whisper と Google STT を評価します。

5つの比較軸の概要

| 比較軸 | なぜ重要か |

|---|---|

| 精度(WER/CER) | 文字起こしの信頼性を左右する最も基本的な指標 |

| リアルタイム性 | セッション中のライブ字幕やリアルタイムフィードバックが必要かどうか |

| コスト構造 | 月間のセッション数と録音時間に応じた費用の違い |

| カスタマイズ性 | コーチング用語の辞書登録やモデルのファインチューニングが可能か |

| 日本語対応 | 日本語特有の課題(同音異義語、敬語、カタカナ語)への対応度 |

この5つの軸に沿って、それぞれのエンジンの特徴を見ていきましょう。

Whisper の特徴と強み――オープンソースが生む柔軟性

OpenAI が 2022 年に公開した Whisper は、オープンソースの音声認識モデルです。68 万時間の多言語音声データで学習されており、英語だけでなく日本語を含む 100 以上の言語に対応しています。

Whisper の仕組みとモデルバリエーション

Whisper はエンコーダ・デコーダ型の Transformer アーキテクチャを採用しています。音声をメルスペクトログラムに変換し、テキストとして出力する仕組みです。

現在利用可能な主要モデルは以下の通りです。

| モデル | パラメータ数 | 日本語 WER 目安 | 処理速度 | 用途 |

|---|---|---|---|---|

| large-v3 | 15 億 | 約 5〜8% | 遅い | 最高精度が必要な録音解析 |

| turbo | 8 億 | 約 8〜12% | 速い | バランス重視の実用向け |

| medium | 7.6 億 | 約 10〜15% | やや速い | コスト重視の大量処理 |

| small | 2.4 億 | 約 15〜20% | 非常に速い | リアルタイム近似処理 |

コーチングセッションの文字起こしでは、large-v3 が精度面で最も推奨されます。1セッション60分の処理に数分〜十数分かかりますが、セッション後の振り返りが目的であれば十分な処理速度です。

API 経由で利用する場合は OpenAI の Whisper API(内部的に large-v3 相当)を使うのが最も手軽です。ローカル実行する場合は GPU 環境が必要になりますが、データを外部に送信しないため守秘義務の観点で有利です。

コーチングセッションでの強み

Whisper がコーチング用途で特に優れている点は3つあります。

1. ノイズ耐性の高さ

Whisper は多様な録音環境のデータで学習されているため、カフェでのコーチングセッションや、マイク品質が不均一なオンラインセッションでも安定した精度を発揮します。WER の劣化が Google STT と比較して少ないという検証結果が報告されています。

2. 句読点・フィラーの自然な処理

Whisper は文字起こし結果に句読点を自動挿入し、フィラー(「えー」「あの」)を文脈に応じて適切に処理します。コーチングの逐語録を作成する際に、手動で句読点を追加する手間が大幅に減ります。

3. 多言語混在への対応

バイリンガルコーチングや、日本語セッション中に英語のフレームワーク名(GROW モデル、NLP など)が頻出する場面でも、言語の切り替えを自動検出して処理します。

注意点

Whisper を選ぶ際に知っておくべき制約もあります。

- リアルタイム処理に非対応: Whisper は録音済み音声のバッチ処理を前提に設計されており、ストリーミング入力には公式に対応していない。WhisperX などの派生ツールで疑似的なリアルタイム処理は可能だが、遅延が発生する

- 話者分離が標準機能にない: 誰が話しているかの識別(ダイアライゼーション)は Whisper 単体ではできない。pyannote-audio など外部ライブラリとの組み合わせが必要

- 自前インフラのコスト: ローカル実行には GPU サーバーが必要。API 利用の場合はインフラ不要だが、大量処理時のコストに注意

Google Speech-to-Text の特徴と強み――エンタープライズ基盤の安定感

Google Speech-to-Text(以下 Google STT)は、Google Cloud Platform(GCP)が提供するマネージド音声認識サービスです。Google の検索エンジンや Google アシスタントで培われた音声認識技術がベースになっています。

Google STT のアーキテクチャと Chirp モデル

Google STT には2つの API バージョンがあります。

- V1 API: 従来型の音声認識モデル。安定性が高く、実績が豊富

- V2 API(Chirp 2): 2024 年以降に提供開始された新世代モデル。Universal Speech Model(USM)ベースで、100 以上の言語に対応

コーチング用途では V2 API の Chirp 2 モデル が推奨されます。従来モデルと比較して日本語の認識精度が向上しており、特に自然な会話音声での精度改善が報告されています。

| 特徴 | V1 API | V2 API(Chirp 2) |

|---|---|---|

| 日本語精度 | 良好 | より高精度 |

| リアルタイム | 対応 | 対応 |

| 話者分離 | 対応(最大 6 名) | 対応(最大 6 名) |

| 自動句読点 | 対応 | 対応 |

| 料金 | $0.006/15 秒 | $0.016/15 秒 |

コーチングセッションでの強み

Google STT がコーチング用途で優位な点も3つあります。

1. リアルタイムストリーミング

Google STT の最大の強みは、音声をリアルタイムで文字起こしできることです。セッション中にライブ字幕を表示したり、特定のキーワードが出現したときにコーチへ通知を送るといった仕組みを構築できます。

2. 話者分離(ダイアライゼーション)の標準搭載

API に話者分離機能が組み込まれており、追加のライブラリなしで「コーチの発話」と「クライアントの発話」を分離できます。最大6名まで対応するため、グループコーチングや研修でも活用可能です。

3. フレーズヒントによるカスタマイズ

API リクエストに speech_contexts パラメータでフレーズヒントを渡すことで、特定の単語やフレーズの認識精度を向上させられます。コーチング特有の専門用語(「メタ認知」「リフレクション」「アクティブリスニング」など)を事前登録しておけば、認識ミスを減らせます。

注意点

Google STT を選ぶ際の制約も把握しておきましょう。

- コストが使用量に比例: 従量課金のため、多数のセッションを処理する場合はコストが膨らむ。V2 API は V1 の約 2.7 倍の単価

- ファインチューニング不可: Whisper のようにモデル自体をカスタムデータで再学習することはできない。フレーズヒントによる表層的な調整に限られる

- GCP への依存: Google Cloud のアカウント開設と API 有効化が必要。オンプレミス環境での実行はできない

5軸比較表で一目瞭然――Whisper vs Google STT 徹底比較

ここまでの分析を、5つの比較軸で整理します。各エンジンの得意・不得意が一目で分かるようにまとめました。

精度・日本語対応・リアルタイム性の比較

| 比較軸 | Whisper(large-v3) | Google STT(Chirp 2) | 判定のポイント |

|---|---|---|---|

| 精度(WER) | 約 5〜8%(日本語) | 約 8〜12%(日本語) | クリーンな録音では Whisper が優位。ただし条件により変動 |

| 日本語対応 | 多言語統合モデルで自然な日本語を処理 | Chirp 2 で日本語精度が向上。敬語・ビジネス用語に強い | 日常会話の日本語は Whisper、ビジネス日本語は Google が安定 |

| リアルタイム性 | 非対応(バッチ処理のみ) | 対応(ストリーミング API) | リアルタイム字幕が必要なら Google 一択 |

コスト・カスタマイズ性・導入ハードルの比較

| 比較軸 | Whisper | Google STT | 判定のポイント |

|---|---|---|---|

| コスト(60 分の音声) | API: 約 $0.36 / ローカル: GPU 電気代のみ | V1: 約 $1.44 / V2: 約 $3.84 | Whisper が大幅に安い。大量処理ほど差が拡大 |

| カスタマイズ性 | モデルのファインチューニング可能。LoRA 等の軽量手法も利用可 | フレーズヒントによる調整のみ。モデル自体の変更は不可 | 独自用語が多い場合は Whisper が有利 |

| 導入ハードル | API は容易。ローカル実行は GPU 環境構築が必要 | GCP アカウント + API 有効化で即利用可能 | 手軽さでは Google。柔軟性では Whisper |

| 話者分離 | 外部ライブラリ(pyannote 等)との連携が必要 | API 標準搭載(最大 6 名) | Google が圧倒的に簡単 |

| データプライバシー | ローカル実行なら外部送信なし | Google Cloud にデータ送信が必要 | 守秘義務が厳しい場合は Whisper ローカル実行 |

AI 文字起こしの精度指標(WER・CER)の詳細については、別記事で体系的に解説しています。精度の数値をより深く理解したい方はあわせてご確認ください。

コーチング現場のシナリオ別――最適エンジンの選び方

比較表を見ても「結局、自分のケースではどちらがいいのか」が分からないという方のために、コーチングの典型的なシナリオごとに最適なエンジンを整理します。

1対1セッションの録音文字起こし

推奨: Whisper(large-v3)

1対1のコーチングセッションを録音し、セッション後に文字起こしして振り返りに活用するケースです。

- リアルタイム性は不要(セッション後の処理で十分)

- 精度を最優先したい(クライアントの発言を正確に記録)

- コストを抑えたい(月間 10〜30 セッションの個人コーチ)

Whisper API なら 60 分のセッションを約 $0.36 で処理できます。月 20 セッションでも約 $7.2 です。文字起こし結果を AI 要約やフィードバックレポートの入力として活用する場合は、音声 AI を使ったフィードバック自動生成の手順が参考になります。

グループセッション・研修の文字起こし

推奨: Google STT(Chirp 2)

3〜6 名が参加するグループコーチングや、企業研修のファシリテーション記録を残すケースです。

- 話者分離が必須: 誰がどの発言をしたかを記録する必要がある

- 参加者ごとの発言量を定量化したい: ファシリテーションの改善に活用

- 研修効果の測定データとして使いたい: 参加者の発言頻度や内容を分析

Google STT の話者分離機能は最大 6 名に対応しており、追加設定なしで利用できます。Whisper で同等の機能を実現するには pyannote-audio との連携が必要で、セットアップの手間がかかります。

リアルタイムフィードバックが必要な場面

推奨: Google STT(ストリーミング API)

セッション中にライブ字幕を表示したり、特定のキーワード(「目標」「課題」「次のアクション」など)の出現をリアルタイムで検知したい場合です。

- オンラインセッションの字幕表示: 聴覚障害のあるクライアントへの対応

- コーチのリアルタイム支援: セッション中に重要な発言をハイライトする仕組み

- 研修のライブモニタリング: 複数グループの議論状況をリアルタイムで把握

この用途では Whisper は選択肢になりません。Google STT のストリーミング API が唯一の現実的な選択肢です。

ハイブリッド運用という第三の選択肢

「Whisper か Google か」の二者択一にこだわる必要はありません。実際の運用では、それぞれの強みを活かした ハイブリッド運用 が最も効果的です。

Whisper x Google STT の組み合わせパターン

以下のような使い分けが実践的です。

セッション中(リアルタイム)

└─ Google STT ストリーミング API

├─ ライブ字幕の表示

├─ キーワード検知 → コーチへの通知

└─ 話者分離による発言ログ

セッション後(バッチ処理)

└─ Whisper large-v3

├─ 高精度な逐語録の生成

├─ AI 要約の入力データ

└─ フィードバックレポートの自動生成この構成では、セッション中は Google STT でリアルタイム支援を行い、セッション後に Whisper で高精度な逐語録を生成します。最終的な記録・ナレッジとして残すのは Whisper の出力を使い、リアルタイム支援の用途では Google STT を活用するという役割分担です。

コストも最適化されます。リアルタイム処理は Google STT の課金が発生しますが、セッション後のバッチ処理は Whisper API の低コストで賄えます。

AI 文字起こしを活かしたナレッジ活用

文字起こしエンジンの選定は、最終的な活用方法とセットで考えるべきです。文字起こしのテキストデータは、以下のような形でコーチングの質を高める資産になります。

- セッション要約の自動生成: 文字起こし結果を GPT-4o 等の LLM に渡して、セッションのサマリーを自動作成

- フィードバックレポートの定量化: 傾聴スコアや質問技法の分析に活用

- ナレッジベースの蓄積: セッションの知見を組織のナレッジとして蓄積・検索可能にする

コーチングセッションを AI でナレッジ化する5つのステップでは、文字起こしから始まるナレッジ蓄積の全体像を解説しています。エンジン選定の判断材料として、活用方法の具体像を先に描いておくことをおすすめします。

まとめ――「精度」だけで選ばない文字起こしエンジンの選定基準

Whisper と Google Speech-to-Text の比較を通じて見えてきたのは、「精度が高い=最適」ではない ということです。コーチング用途の文字起こしでは、セッション形式・リアルタイム性の要否・話者分離の必要性・予算・守秘義務の厳しさなど、複数の要素を総合的に判断する必要があります。

迷ったときは、以下の判定フローを参考にしてください。

Q1: リアルタイム字幕やライブ検知が必要?

├─ はい → Google STT

└─ いいえ → Q2 へ

Q2: 3 名以上のグループセッション?

├─ はい → Google STT(話者分離の簡易さ)

└─ いいえ → Q3 へ

Q3: コストを最小限に抑えたい?

├─ はい → Whisper API

└─ いいえ → Q4 へ

Q4: データを外部に送信できない(守秘義務)?

├─ はい → Whisper ローカル実行

└─ いいえ → Whisper API(精度とコストのバランス)そして、もし両方の利点を最大限活かしたいなら、セッション中は Google STT、セッション後は Whisper というハイブリッド運用を検討してみてください。

BootCast では Whisper ベースの AI 文字起こしを搭載し、コーチングセッションの自動要約とナレッジ蓄積を実現しています。文字起こしエンジンの性能を活かした音声コーチングの仕組みに興味がある方は、ぜひプラットフォームの詳細をご覧ください。