WebRTC とは?ブラウザだけで高品質音声配信ができる技術の裏側

WebRTCの仕組みをP2P・SFU・MCUの配信方式から暗号化まで図解で解説。RTMP/HLSとの遅延比較や、コーチング・教育で選ばれる理由も紹介します。

「アプリを入れてください」で離脱する参加者たち

「まず専用アプリをダウンロードしてください」——オンラインセミナーやコーチングセッションの案内でこの一文を見た瞬間、参加をやめた経験はないでしょうか。

音声を使ったリアルタイムの学びやコーチングは、対面に近い臨場感を届けられる強力な手段です。ところが、実際の運営現場では「参加のハードル」と「配信品質」という2つの壁が、その価値を大きく損ねています。

専用アプリの壁が生む参加率の低下

Zoom や Teams のようなビデオ会議ツールは、初回利用時にアプリのインストールやアカウント作成を求めるケースが少なくありません。ITリテラシーにばらつきがある組織やクライアント向けのセッションでは、この「事前準備」だけで参加率が 10〜20% 落ちるという報告もあります。

特に深刻なのは、社外のクライアントやゲストを招くケースです。企業のセキュリティポリシーで特定のアプリをインストールできない、端末の管理権限がない、あるいは単純に「面倒だから後でいいか」と先延ばしにされる——いずれの場合も、コンテンツの質以前にアクセスの段階で離脱が発生します。

配信遅延がリアルタイムコーチングを台無しにする瞬間

もうひとつの壁は 遅延 です。従来のライブ配信技術(後述する RTMP や HLS)では、話し手の声が聞き手に届くまでに数秒から数十秒のタイムラグが生じます。

友人とのカジュアルな雑談であれば数秒の遅延は許容できるかもしれません。しかし、コーチがクライアントの発言に即座にフィードバックを返す「対話型セッション」や、参加者がリアルタイムで質問を投げかける「ライブQ&A」では、わずか 2〜3 秒の遅延が会話のリズムを壊します。発言がかぶる、沈黙のタイミングがずれる、ニュアンスが伝わらない——遅延はコーチングの生命線である ラポール(信頼関係)の構築 を静かに蝕みます。

この2つの問題を根本から解決する技術が、WebRTC です。

WebRTC とは何か——ブラウザがそのまま通話アプリになる技術

WebRTC(Web Real-Time Communication) は、Web ブラウザ同士でリアルタイムに音声・映像・データをやり取りするためのオープンな通信技術です。Google が 2011 年にオープンソースとして公開し、現在は W3C(World Wide Web Consortium)と IETF(Internet Engineering Task Force)によって国際標準として策定されています。

最大の特徴は、ブラウザだけで動作する こと。専用アプリのインストールもプラグインの追加も必要ありません。URL をクリックするだけで、音声通話やビデオ通話、画面共有がすぐに始まります。

Web Real-Time Communication の3つのコア機能

WebRTC は、以下の3つの API(アプリケーションプログラミングインターフェース)を中核として設計されています。

| API | 役割 | 具体例 |

|---|---|---|

| MediaStream | カメラ・マイクなどのメディアデバイスにアクセスし、音声や映像のストリームを取得する | マイクの音声をブラウザ上で取得する |

| RTCPeerConnection | ブラウザ間の通信経路を確立し、音声・映像をリアルタイムに送受信する | 2つのブラウザ間で音声通話を行う |

| RTCDataChannel | テキストやバイナリデータをブラウザ間で直接やり取りする | チャットメッセージやファイルを送受信する |

この3つの API が連携することで、「マイクから声を拾い、暗号化して相手のブラウザに直接届ける」という一連の処理がブラウザ内部で完結します。開発者はこれらの API を組み合わせることで、複雑なインフラを自前で構築しなくてもリアルタイム通信機能を実装できます。

W3C と IETF が標準化した安心のオープン規格

WebRTC を語るうえで見逃せないのが、国際標準規格 としての位置づけです。

Web 技術の標準化を担う W3C が API 仕様を策定し、インターネットの通信プロトコルを策定する IETF が通信規格を定めています。Google Chrome、Apple Safari、Mozilla Firefox、Microsoft Edge——主要ブラウザすべてが WebRTC を標準サポートしており、特定のベンダーにロックインされるリスクがありません。

オープンソースであることは、透明性とセキュリティの面でも大きな利点です。世界中の開発者がコードをレビューし、脆弱性が発見されれば迅速に修正される。クローズドな商用プロトコルでは得られない安心感が、WebRTC が教育・医療・金融など信頼性が求められる分野でも採用されている理由のひとつです。

なぜ超低遅延を実現できるのか——WebRTC の通信の仕組み

WebRTC の最大の強みは 200 ミリ秒以下の超低遅延 です。人間が会話で「自然だ」と感じる遅延の上限は約 150〜300 ミリ秒とされており、WebRTC はまさにこの範囲内でリアルタイム通信を実現しています。なぜそれが可能なのか、通信の仕組みを段階的に見ていきましょう。

P2P 接続とシグナリングの役割

WebRTC の基本は P2P(Peer-to-Peer)通信 です。通常の Web 通信では、ブラウザ → サーバー → ブラウザというルートでデータが中継されますが、WebRTC では可能な限りブラウザ同士が直接データを送受信します。中継サーバーを経由しない分、遅延が最小限に抑えられるのです。

ただし、P2P 接続を始めるためには シグナリング と呼ばれる事前交渉が必要です。シグナリングでは、以下の情報をシグナリングサーバーを介して交換します。

- SDP(Session Description Protocol): 使用するコーデック、帯域幅、メディアの種類などの通信条件

- ICE Candidate: 接続可能な IP アドレスとポート番号の候補リスト

シグナリングが完了すると、以降のメディアデータ(音声・映像)はサーバーを経由せず、ブラウザ同士で直接やり取りされます。

NAT 越えを支える STUN / TURN サーバー

家庭やオフィスのネットワークでは、ルーターの NAT(Network Address Translation) によってプライベート IP アドレスがグローバル IP アドレスに変換されています。P2P 接続を確立するには、相手のグローバル IP アドレスとポート番号を知る必要がありますが、NAT の内側にいるブラウザは自分のグローバルアドレスを直接知ることができません。

この問題を解決するのが STUN サーバー と TURN サーバー です。

- STUN(Session Traversal Utilities for NAT): ブラウザが自分のグローバル IP アドレスとポート番号を発見するためのサーバー。軽量で高速

- TURN(Traversal Using Relays around NAT): STUN で直接接続できない場合(厳格なファイアウォール環境など)に、メディアデータを中継するリレーサーバー。遅延はやや増えるが、接続の確実性を担保する

実際の接続では、まず STUN を試み、それでもつながらない場合にフォールバックとして TURN を使用する ICE(Interactive Connectivity Establishment) という仕組みが自動的に最適な経路を選択します。利用者が接続方式を意識する必要はありません。

DTLS / SRTP による暗号化で「盗聴されない声」を届ける

WebRTC の通信は すべて暗号化が必須 です。これは仕様レベルで強制されており、暗号化なしの通信は許可されません。

| プロトコル | 用途 | 説明 |

|---|---|---|

| DTLS | 鍵交換・認証 | UDP 上で動作する TLS。通信開始時に暗号鍵を安全に交換し、通信相手を認証する |

| SRTP | メディア暗号化 | 音声・映像データを DTLS で交換した鍵を使って暗号化。パケット単位で暗号化されるため傍受されても復号できない |

HTTPS が Web ページの閲覧を暗号化するように、WebRTC は音声・映像の通信をプロトコルレベルで暗号化します。コーチングセッションで交わされる個人的な会話や、企業の機密に触れるディスカッションであっても、第三者に盗聴されるリスクを技術的に排除できるのです。

1 対 1 から数百人規模へ——配信アーキテクチャの進化

WebRTC の P2P 通信は 1 対 1 の通話に最適化されています。しかし、コーチングやセミナーでは「1 人の話し手が数十〜数百人に配信する」ケースが一般的です。参加人数が増えるにつれて、アーキテクチャ(配信の仕組み)はどう変わるのでしょうか。

P2P・SFU・MCU の違いを図解で理解する

WebRTC の配信アーキテクチャは、大きく3種類に分かれます。

P2P(Peer-to-Peer)方式

ブラウザA ←→ ブラウザB

ブラウザA ←→ ブラウザC

ブラウザB ←→ ブラウザC各ブラウザが他のすべてのブラウザと直接接続します。参加者が N 人の場合、各端末は N-1 本の接続を維持する必要があり、端末の CPU やネットワーク帯域への負荷が急激に増大します。3〜4 人までの小規模なグループ通話には適していますが、10 人を超えると現実的ではありません。

SFU(Selective Forwarding Unit)方式

ブラウザA → [SFUサーバー] → ブラウザB

→ ブラウザC

→ ブラウザD各ブラウザは SFU サーバーに対して 1 本だけ音声を送信し、SFU サーバーが受け取った音声をそのまま(再エンコードせずに)各視聴者に転送します。送信側の負荷は参加者数に関わらず一定で、サーバー側も転送のみなので CPU 負荷が低い。数十〜数百人規模の配信に適しています。

MCU(Multipoint Control Unit)方式

ブラウザA → [MCUサーバー] → 合成音声 → ブラウザB

ブラウザB → → ブラウザC

ブラウザC → → ブラウザAMCU サーバーが複数の音声ストリームをミキシング(合成)して 1 本のストリームとして配信します。受信側の帯域負荷が最も軽い一方、サーバーの CPU 負荷が高く、ミキシング処理による遅延が追加されます。

3 方式の特性を比較すると以下のとおりです。

| 項目 | P2P | SFU | MCU |

|---|---|---|---|

| サーバー負荷 | 不要(シグナリングのみ) | 低〜中(転送のみ) | 高(ミキシング処理) |

| 端末負荷 | 高(接続数に比例) | 中 | 低 |

| 遅延 | 最小 | 低 | 中(ミキシング分) |

| 適正人数 | 2〜4 人 | 5〜数百人 | 5〜数十人 |

| スケーラビリティ | 低 | 高 | 中 |

SFU が音声コーチングに最適な理由

音声コーチングの配信に最も適しているのは SFU 方式 です。理由は3つあります。

1. 低遅延を維持できる SFU はメディアデータを再エンコードせずそのまま転送するため、P2P に近い低遅延を実現できます。コーチとクライアントの「対話のリズム」を損なわずに、多人数のリスナーにも配信できます。

2. スケーラビリティが高い コーチ 1 名が話し、数十名のメンバーが視聴するセミナー形式でも、コーチ側の端末負荷は一定です。参加者が増えてもコーチの配信品質が劣化しないため、セッション中のストレスがありません。

3. 音声品質が劣化しない MCU のように音声をミキシングしないため、オリジナルの音声品質がそのまま各視聴者に届きます。コーチの声のトーン、間、抑揚——いわゆる パラ言語情報 を忠実に伝達できる点は、コーチングにおいて決定的に重要です。

たとえば LiveKit のような WebRTC ベースの SFU プラットフォームは、グローバルに分散した SFU サーバー群を提供し、クラウド環境でのスケーラブルな音声配信を実現しています。

従来方式との比較——RTMP / HLS では得られないもの

「ライブ配信」と聞くと YouTube Live や Twitch を思い浮かべる方も多いでしょう。これらのサービスは RTMP(Real-Time Messaging Protocol) や HLS(HTTP Live Streaming) といった従来の配信プロトコルを使用しています。WebRTC との違いを具体的な数値で比較します。

遅延時間の比較テーブル

| プロトコル | 典型的な遅延 | 双方向性 | 主な用途 |

|---|---|---|---|

| WebRTC | 200 ミリ秒以下 | 完全な双方向 | ビデオ会議、音声コーチング、リアルタイムセッション |

| RTMP | 3〜5 秒 | 片方向(視聴者→チャットのみ) | ゲーム配信、ライブコマース |

| HLS | 10〜30 秒 | 片方向 | 大規模ライブ配信、イベント中継 |

| LL-HLS | 2〜6 秒 | 片方向 | 低遅延が求められるスポーツ中継 |

WebRTC の 200 ミリ秒以下という遅延は、RTMP と比較して 15 倍以上高速 です。HLS との差にいたっては 50〜150 倍。この数値差は、リアルタイムのコミュニケーションにおいて質的な体験の違いを生みます。

双方向性と音声品質のトレードオフを超える

RTMP や HLS は「1 人の配信者が大勢に映像を届ける」ことに最適化されたプロトコルです。視聴者からのフィードバックはテキストチャットに限定され、音声でのリアルタイムなやり取りは想定されていません。

一方、WebRTC は設計思想そのものが 双方向通信 です。音声のアップストリーム(送信)とダウンストリーム(受信)が対等に扱われるため、以下のようなインタラクションが自然に実現します。

- コーチの問いかけに参加者が 音声で即座に 回答する

- 参加者がリアルタイムで質問し、コーチがその場で応答する

- グループディスカッションで複数人が自由に発言する

「大規模配信なら RTMP / HLS、リアルタイム対話なら WebRTC」と使い分けるのが技術選定のセオリーです。音声コーチングやインタラクティブなセミナーのように 双方向性が価値の核心 にあるユースケースでは、WebRTC が唯一の現実的な選択肢といえます。

コーチング・教育で WebRTC が選ばれる3つの理由

技術的な仕組みを理解したところで、コーチングや教育の現場で WebRTC がどのような価値を発揮するのかを具体的に見ていきましょう。

ゼロフリクション入室が参加率を変える

冒頭で触れた「アプリのインストール壁」を、WebRTC は根本から取り除きます。参加者は共有された URL をクリックするだけでブラウザが開き、音声セッションに参加できます。

この「ゼロフリクション」がもたらすインパクトは、参加率の数値に直結します。アプリのダウンロードが不要になることで、以下のような効果が期待できます。

- 初回参加者の離脱率が低下する

- スマートフォンからの参加が容易になる(ストレージ容量を気にしなくてよい)

- 社外のクライアントやゲストを招きやすくなる

- IT サポート対応の工数が減る

音声配信の始め方を検討しているコーチにとって、参加者のアクセスハードルを最小化できる技術基盤は、コンテンツの質と同じくらい重要な要素です。

リアルタイムの声がラポール形成を加速する

心理学では、コーチとクライアントの間の信頼関係を ラポール(rapport) と呼びます。ラポールの構築には、声のトーン、間の取り方、相づちのタイミングといった 非言語的コミュニケーション が不可欠です。

WebRTC の 200 ミリ秒以下の低遅延は、対面に近いリアルタイム性を実現します。コーチが「それ、もう少し詳しく聞かせてもらえますか?」と問いかけた瞬間にクライアントの声が返ってくる。この「会話のキャッチボール」の自然さが、オンラインでありながら対面のような心理的安全性を生み出します。

テキストチャットでは伝わらないニュアンス、ビデオ会議では重すぎる帯域負荷——音声に特化した WebRTC 配信は、この両者の間を埋める「ちょうどいい」コミュニケーション手段として、プラットフォーム選択の重要な判断基準になっています。

AI との連携で「声」が自動でナレッジ資産に変わる

WebRTC がもたらすもうひとつの可能性は、AI との組み合わせ です。

WebRTC で配信された音声は、リアルタイムまたは録音後に AI 文字起こしエンジン(OpenAI Whisper など)で自動的にテキスト化できます。さらに、そのテキストを大規模言語モデル(LLM)で要約・構造化すれば、コーチングセッションの内容が自動的に「ナレッジ資産」として蓄積されていきます。

具体的なワークフローの例を示します。

- WebRTC でライブ音声コーチングセッションを実施

- セッション音声を AI 文字起こしで自動テキスト化

- LLM が要点・アクションアイテム・次回の論点を自動抽出

- ナレッジベースに蓄積し、メンバーがいつでも検索・復習可能

従来のコーチングでは、セッションの内容はその場限りの「揮発性の知識」でした。WebRTC + AI のパイプラインは、「声」を永続的なナレッジに変換する技術基盤として機能します。

WebRTC の課題と今後の展望

WebRTC は強力な技術ですが、万能ではありません。導入を検討する際に知っておくべき課題と、今後の技術動向を整理します。

大規模配信と回線品質への依存

参加者数のスケーリング は、WebRTC の設計上の制約です。P2P 方式では 4〜5 人が限界であり、SFU を導入しても数千人規模の同時配信には専用のインフラ設計が必要になります。YouTube Live のように数十万人が同時視聴する大規模配信は、RTMP / HLS のほうが適しています。

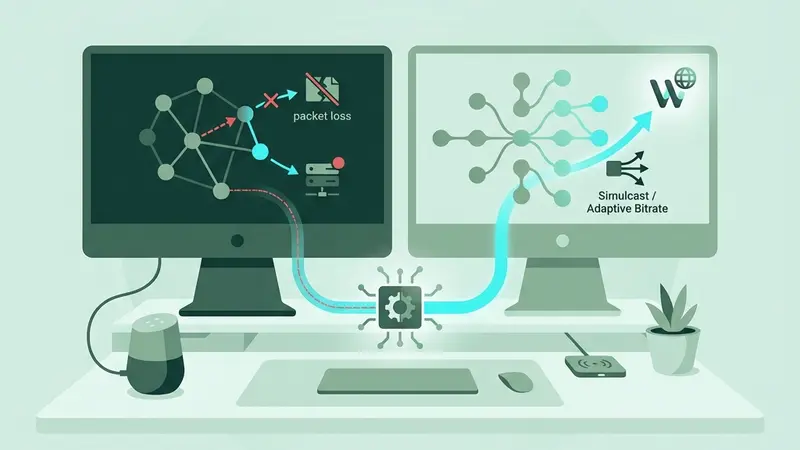

もうひとつの課題は 回線品質への依存 です。WebRTC は UDP ベースのプロトコルであり、パケットロスが発生すると音声品質が直接的に影響を受けます。参加者の回線環境が不安定な場合、音声が途切れる・ノイズが入るといった品質劣化が生じます。

ただし、最新の WebRTC 実装では Simulcast(複数の品質レベルで同時に配信し、受信側の回線状況に応じて自動切り替え)や Adaptive Bitrate(帯域に応じてビットレートを動的に調整)などの技術で、これらの課題を大幅に軽減しています。

2026 年以降のトレンド——WebTransport と AI リアルタイム処理

WebRTC の進化は止まっていません。注目すべきトレンドを2つ紹介します。

WebTransport の台頭 HTTP/3(QUIC)上で動作する新しい通信プロトコル WebTransport が標準化に向けて進んでいます。WebRTC のシグナリングの複雑さを簡素化しつつ、低遅延通信を実現する技術として注目されています。WebRTC を置き換えるものではなく、ユースケースに応じて補完的に使い分ける関係になると考えられています。

AI リアルタイム処理との融合 WebRTC で配信された音声を、サーバーサイドで AI がリアルタイムに処理するアーキテクチャが急速に発展しています。リアルタイム文字起こし、同時通訳、感情分析、発話内容の要約——これらが配信と並行して処理されることで、「ライブ配信しながら AI がナレッジを自動生成する」というワークフローが現実のものになりつつあります。

音声コーチングの領域では、セッション中にリアルタイムでコーチングの要点を抽出し、セッション終了直後にクライアントへサマリーを自動送信するといった体験が実現可能です。

まとめ——「声」の技術を理解して、最適な音声基盤を選ぶ

WebRTC は、ブラウザだけで超低遅延のリアルタイム音声通信を実現するオープン技術です。P2P 通信による最小遅延、SFU アーキテクチャによるスケーラビリティ、DTLS / SRTP による通信暗号化——これらの技術要素が組み合わさることで、「URL をクリックするだけで高品質な音声セッションに参加できる」体験が成り立っています。

本記事のポイントを整理します。

- WebRTC は W3C / IETF が標準化したオープン規格で、主要ブラウザすべてが対応

- 遅延は 200 ミリ秒以下。RTMP(3〜5 秒)や HLS(10〜30 秒)とは桁違いの即時性

- P2P → SFU → MCU と、参加規模に応じた配信アーキテクチャを選択可能

- 通信は DTLS / SRTP で強制暗号化。セキュリティが仕様レベルで担保される

- AI との連携により、音声をリアルタイムでナレッジ資産に変換する基盤として機能する

音声コーチングや教育の場面で「アプリ不要」「低遅延」「双方向」の3条件を同時に満たせる技術は、現時点で WebRTC 以外にありません。配信の技術基盤を選ぶ際は、まず「何人が参加するか」「双方向性がどの程度必要か」を明確にしたうえで、WebRTC(SFU)/ RTMP / HLS の使い分けを検討してみてください。

BootCast は WebRTC ベースの SFU アーキテクチャを採用し、ブラウザだけで音声コーチングセッションを完結できるプラットフォームです。技術の裏側を理解した今こそ、「声で届けるコーチング」の可能性をぜひ体感してみてください。